כיצד פותחו הרשתות הנוירוניות שמחקות את הלמידה האנושית?

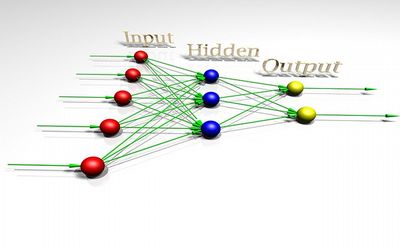

רשתות נוירונים (Neural Networks) הן רשתות מחשבים מתקדמות שמחקות את החשיבה האנושית.

בשנות ה-40 של המאה ה-20 ישב נוירולוג בשם וורן מקאלוך (Warren McCulloch) לצד נער-פלא בשם וולטר פיטס (Walter Pitts) ושאל שאלה שנשמעה אז כמעט מגוחכת: מה אם נוכל לתאר את תאי העצב של המוח בשפת מתמטיקה?

פיטס, שגדל בדטרויט במשפחה קשה, ברח בגיל 12 מבריונים של השכונה לספרייה הציבורית. שם נתקל בספר הפילוסופי המסורבל "פרינציפיה מתמטיקה" (Principia Mathematica) של ברטרנד ראסל (Bertrand Russell) וסיים לקרוא את שלושת כרכיו תוך שלושה ימים.

פיטס מצא בספר הנודע טעויות, כתב על כך לראסל, ראסל הזמין אותו ללמוד בקיימברידג', אך פיטס בן ה-12 סירב בנימוס. כשהיה בן 15 ושמע שראסל מגיע לאוניברסיטת שיקגו, הוא ברח מהבית באמצע הלילה ולא שב למשפחתו יותר.

ב-1943 פרסמו מקאלוך ופיטס מאמר שהפך לאחד החשובים בתולדות המדע. במאמר הם הראו שאפשר לדגם נוירון ביולוגי כיחידה לוגית פשוטה המקבלת קלטים ומוציאה פלט. זה היה המודל הממוחשב הראשון של תא עצב.

שנים אחדות אחר כך הציע הפסיכולוג הקנדי דונלד הב (Donald Hebb) תובנה שנשמעת פשוטה אך שינתה את הכל: ככל שנוירון אחד מפעיל נוירון אחר שוב ושוב, הקשר ביניהם מתחזק. זהו בדיוק עיקרון הלמידה ו"כלל הב" (Hebb's Rule) מנחה עד היום כיצד מכונות לומדות.

ב-1958 בנה פרנק רוזנבלט (Frank Rosenblatt) את ה"פרספטרון" (Perceptron), מכונה שסיווגה תמונות פשוטות. רוזנבלט הבטיח שהיא תדע בהצשך גם לדבר ולתרגם שפות.

העיתונות התלהבה מהרעיונות של רוזנבלט, אך כעשור לאחר מכן הוכיח המתמטיקאי מרווין מינסקי (Marvin Minsky) שלפרספטרון יש מגבלות קשות, מה שהביא לכך שהתחום קפא, למשל שנות קיפאון שיוודעו בשם "חורף הבינה המלאכותית" (AI Winter).

הפריצה הגדולה הגיעה ב-1986, כשג'פרי הינטון (Geoffrey Hinton) ועמיתיו פרסמו מאמר שהנגיש את אלגוריתם ה"התפשטות לאחור" (Backpropagation). זו הייתה שיטה שאיפשרה לרשת בעלת שכבות מרובות ללמוד מטעויותיה. הינטון, יאן לקון (Yann LeCun) ויושואה בנג'יו (Yoshua Bengio) קיבלו יחד את פרס טיורינג ב-2018 ומכונים מאז "סנדקי הלמידה העמוקה" (Godfathers of Deep Learning).

ב-2024 קיבל הינטון את פרס נובל בפיזיקה, יחד עם ג'ון הופילד (John Hopfield), על עבודה שהתחילה כניסוי אקדמי צנוע. כשביקש ממנו כתב של הניו-יורק טיימס להסביר את המכונה שלו במשפטים פשוטים, הינטון ענה בחיוך: "אם יכולתי להסביר את זה תוך כמה דקות, זה לא היה שווה פרס נובל."

מה שמאחד את כל החוקרים שפיתחו את רשתות הנוירונים הממוחשבות הוא דבר אחד וברור: הם לא המציאו אינטליגנציה מאפס, אלא הביטו על המוח, על תאי העצב ועל הדרך שבה בני אדם לומדים ושאלו כיצד אפשר לחקות את זה. הטבע היה המהנדס הראשון ןבכך כנראה שהם רק עזרו, עזרה אדירה אמנם, לפתח את רשתות הנוירונים של עולם ה-AI.

המלצה:

======

קראו באאוריקה בתגית גוף האדם על עוד מערכות בגוף ונסו להעלות רעיונות לעוד פיתוחים טכנולוגיים שיפתרו בעיות בעולם באמצעות חיקוי של פתרונות שבמערכות גופנו.

רשתות נוירונים (Neural Networks) הן רשתות מחשבים מתקדמות שמחקות את החשיבה האנושית.

בשנות ה-40 של המאה ה-20 ישב נוירולוג בשם וורן מקאלוך (Warren McCulloch) לצד נער-פלא בשם וולטר פיטס (Walter Pitts) ושאל שאלה שנשמעה אז כמעט מגוחכת: מה אם נוכל לתאר את תאי העצב של המוח בשפת מתמטיקה?

פיטס, שגדל בדטרויט במשפחה קשה, ברח בגיל 12 מבריונים של השכונה לספרייה הציבורית. שם נתקל בספר הפילוסופי המסורבל "פרינציפיה מתמטיקה" (Principia Mathematica) של ברטרנד ראסל (Bertrand Russell) וסיים לקרוא את שלושת כרכיו תוך שלושה ימים.

פיטס מצא בספר הנודע טעויות, כתב על כך לראסל, ראסל הזמין אותו ללמוד בקיימברידג', אך פיטס בן ה-12 סירב בנימוס. כשהיה בן 15 ושמע שראסל מגיע לאוניברסיטת שיקגו, הוא ברח מהבית באמצע הלילה ולא שב למשפחתו יותר.

ב-1943 פרסמו מקאלוך ופיטס מאמר שהפך לאחד החשובים בתולדות המדע. במאמר הם הראו שאפשר לדגם נוירון ביולוגי כיחידה לוגית פשוטה המקבלת קלטים ומוציאה פלט. זה היה המודל הממוחשב הראשון של תא עצב.

שנים אחדות אחר כך הציע הפסיכולוג הקנדי דונלד הב (Donald Hebb) תובנה שנשמעת פשוטה אך שינתה את הכל: ככל שנוירון אחד מפעיל נוירון אחר שוב ושוב, הקשר ביניהם מתחזק. זהו בדיוק עיקרון הלמידה ו"כלל הב" (Hebb's Rule) מנחה עד היום כיצד מכונות לומדות.

ב-1958 בנה פרנק רוזנבלט (Frank Rosenblatt) את ה"פרספטרון" (Perceptron), מכונה שסיווגה תמונות פשוטות. רוזנבלט הבטיח שהיא תדע בהצשך גם לדבר ולתרגם שפות.

העיתונות התלהבה מהרעיונות של רוזנבלט, אך כעשור לאחר מכן הוכיח המתמטיקאי מרווין מינסקי (Marvin Minsky) שלפרספטרון יש מגבלות קשות, מה שהביא לכך שהתחום קפא, למשל שנות קיפאון שיוודעו בשם "חורף הבינה המלאכותית" (AI Winter).

הפריצה הגדולה הגיעה ב-1986, כשג'פרי הינטון (Geoffrey Hinton) ועמיתיו פרסמו מאמר שהנגיש את אלגוריתם ה"התפשטות לאחור" (Backpropagation). זו הייתה שיטה שאיפשרה לרשת בעלת שכבות מרובות ללמוד מטעויותיה. הינטון, יאן לקון (Yann LeCun) ויושואה בנג'יו (Yoshua Bengio) קיבלו יחד את פרס טיורינג ב-2018 ומכונים מאז "סנדקי הלמידה העמוקה" (Godfathers of Deep Learning).

ב-2024 קיבל הינטון את פרס נובל בפיזיקה, יחד עם ג'ון הופילד (John Hopfield), על עבודה שהתחילה כניסוי אקדמי צנוע. כשביקש ממנו כתב של הניו-יורק טיימס להסביר את המכונה שלו במשפטים פשוטים, הינטון ענה בחיוך: "אם יכולתי להסביר את זה תוך כמה דקות, זה לא היה שווה פרס נובל."

מה שמאחד את כל החוקרים שפיתחו את רשתות הנוירונים הממוחשבות הוא דבר אחד וברור: הם לא המציאו אינטליגנציה מאפס, אלא הביטו על המוח, על תאי העצב ועל הדרך שבה בני אדם לומדים ושאלו כיצד אפשר לחקות את זה. הטבע היה המהנדס הראשון ןבכך כנראה שהם רק עזרו, עזרה אדירה אמנם, לפתח את רשתות הנוירונים של עולם ה-AI.

המלצה:

======

קראו באאוריקה בתגית גוף האדם על עוד מערכות בגוף ונסו להעלות רעיונות לעוד פיתוחים טכנולוגיים שיפתרו בעיות בעולם באמצעות חיקוי של פתרונות שבמערכות גופנו.